“Es imprescindible debatir y reflexionar sobre la inteligencia artificial”

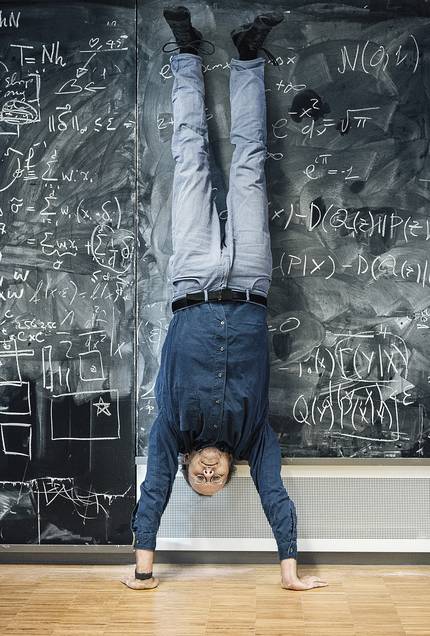

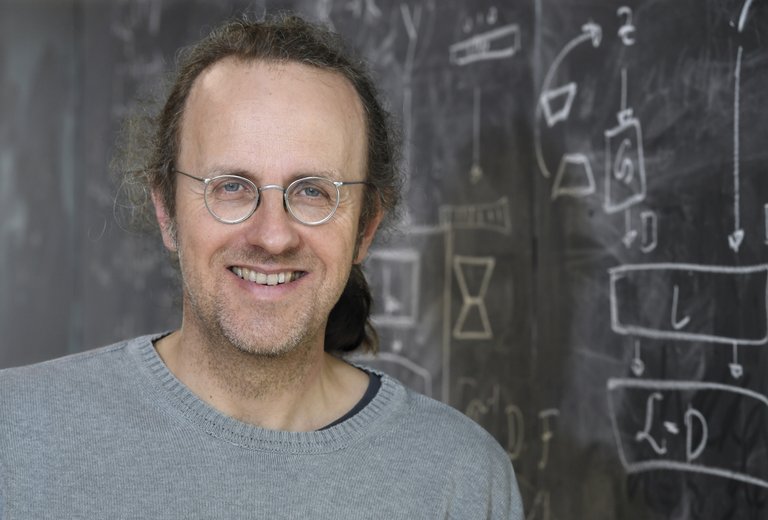

Bernhard Schölkopf es conocido en el mundo de la investigación sobre la inteligencia artificial. Entre otros, es co-director del Instituto de Sistemas Inteligentes Max Planck (en concreto, lidera el Departamento de Inferencias Experimentales) y trabaja en otros centros e instituciones. Sus investigaciones han recibido un gran eco y reconocimiento, entre ellos, uno de los premios BBVA 2020 “Fronteras del Conocimiento” por el desarrollo de métodos kernel. El diálogo comienza con una pregunta sobre ellos, pero a continuación se abordan otros temas: exoplanetas, accesibilidad, sostenibilidad, investigación militar, filosofía, transparencia de la ciencia y participación social…

Es especialista en aprendizaje automático, especialmente en métodos de kernel o causalidad. ¿Qué has trabajado en este campo?

Los métodos Kernel son un campo de aprendizaje automático. En realidad, son métodos de aprendizaje de normas, dependencias o relaciones a partir de las observaciones, y son especiales, ya que están conectados a diferentes campos de las matemáticas: análisis funcional, teoría de la optimización… Así, proporcionan una forma bonita y elegante de aprender reglas a partir de datos, y pueden ser utilizados en campos tan diversos como la medicina o la industria. Son útiles no solo para conocer las relaciones existentes entre los datos, sino para ir más allá y detectar la causalidad. Por lo tanto, el aprendizaje va un nivel más profundo que el automático.

Una de las aplicaciones tal vez no sea la primera que se nos ocurra. En concreto, lo ha utilizado en la detección de exoplanetas. ¿Cómo fue?

Bien. Estaba pasando un año sabático con mi familia en Nueva York y empecé a hablar con astrónomos. A partir de los datos recogidos por el telescopio espacial Kepler, me dijeron que tenían un problema para detectar exoplanetas. De hecho, para detectar exoplanetas, al pasar por delante de su estrella, se basaban en la pérdida de luminosidad de la estrella. Pero esta pérdida es muy pequeña y es difícil distinguirla del ruido que produce la propia observación. Este ruido y los fallos del telescopio se pueden deducir de los datos de otras estrellas, y lo aprovechamos.

Con ello, en pocos años se encontró el carné 20-30 exoplapis que posteriormente se confirmó por otros métodos. Y, poco después, se confirmó, además, que una de ellas se encontraba a una distancia viviente de su estrella. Esto significa que se encontraba a una distancia que permitiera el acceso al agua líquida. El primer exoplaneta que se detectó fue habitable.

¿En qué otros ámbitos se puede aplicar?Por

defecto, en todas las áreas en las que se pueden realizar observaciones experimentales. Es necesario, por un lado, que existan muchos datos, muchas mediciones y, por otro, que haya relaciones entre las diferentes observaciones. Por ejemplo, podemos relacionar las medidas de un biomarcador con el riesgo de tener un tumor, y podemos saber si ese bi-mar puede predecir un tumor antes de detectarlo. Es decir, una regla que se deduce de los datos, incluso cuando es difícil para una persona, detectarla.

Aparte de los métodos de Kernel, ¿cuáles crees que serán los principales desarrollos de la inteligencia artificial?

Ahora mismo uno de los campos más excitantes es el procesamiento del lenguaje natural (NLP). Hace 20 o 10 años, se realizaron muchos estudios sobre la visión computacional: cómo conocer objetos, o cómo distinguir coches y peatones… por ejemplo, para desarrollar coches automáticos. En los últimos 10 años se han producido grandes avances en el análisis del lenguaje y en la predicción de textos. De pronto, los programas son capaces de producir textos. Esto ha creado asombro y fascinación, y creo que en los próximos años va a tener un gran desarrollo.

¿Cómo podemos garantizar que los beneficios de los sistemas de inteligencia artificial lleguen a todos?El primer

paso para que los beneficios de los sistemas de inteligencia artificial sean lo más asequibles posible es la publicación de la investigación. No solo describir métodos en una revista científica, sino también publicar el código. Es más, también los datos que se han utilizado para entrenar este código.

Sin embargo, no es una cuestión de poca monta. Por ejemplo, en medicina, los datos no se pueden hacer públicos de cualquier manera. O, en otro aspecto, quizá no sea conveniente, ya que existe el riesgo de que se usen de manera malintencionada. Pero, en general, si queremos que sea beneficioso para el mayor número de personas y de sociedades, creo que la investigación debe ser lo más transparente posible.

La inteligencia artificial también puede generar problemas en otros ámbitos, como el medio ambienteEs

cierto que para entrenar programas de inteligencia artificial hace falta mucha energía, y esa energía consume muchos recursos. Y los centros de investigación no siempre están en el lugar más adecuado desde el punto de vista de la sostenibilidad.

Pero, desde otro punto de vista, la inteligencia artificial también puede tener un efecto beneficioso sobre el medio ambiente. Efectivamente, el clima es un sistema complejo para el que no tenemos un modelo completo. Las inteligencias artificiales nos pueden ayudar a comprender mejor el clima y nos ayudarán a frenar o mitigar el cambio climático. También nos ayudará a crear mejores tecnologías: mejores células solares, mejores baterías el-tricas…

He leído que usted se ha negado a participar en las investigaciones. ¿Es así?

Sí. Tradicionalmente, en las guerras está implicado el ser humano. Alguien decide atacar o disparar al otro; alguien manda y es una decisión de alguien. Esto significa que hay responsabilidades y sentencias morales.

Y la guerra es siempre mala. Pero si las máquinas se vuelven cada vez más inteligentes y se les asigna la responsabilidad de tomar esas decisiones, ¿de quién es la responsabilidad? ¿De quien ha desarrollado un programa para conocer y matar a una persona? ¿De quien lo ha diseñado? ¿El que la ha vendido? ¿Del gobierno que utiliza el sistema? Es difícil prever cómo esto puede cambiar la guerra.

Creo que hay que discutir sobre ello y que es una cuestión que hay que analizar con mucho cuidado. Pero soy muy escéptico, no veo que estemos haciendo eso. Por lo tanto, siempre intento proteger y alentar a quienes dicen que hay que prohibir este tipo de armas.

Por otra parte, has estudiado filosofía. ¿Cree que es utilizable o, más aún, que es necesario tener en cuenta la filosofía en el desarrollo de la inteligencia artificial?

Sin duda, la filosofía me ha sido muy útil. Creo que cualquier cosa que aprendas puede ser útil alguna vez. Y si has estudiado filosofía, influirá como piensas en los problemas de la inteligencia artificial. Por supuesto, muchos técnicos se ocupan únicamente de los aspectos técnicos de la inteligencia artificial. Pero las preguntas que queremos aclarar no son solo técnicas, es decir, ¿cómo vamos a detectar la estructura del mundo? ¿Por qué parece que el mundo está sujeto a las leyes y no al azar? En mi opinión, este tipo de preguntas son, en el fondo, filosóficas y desde ese punto de vista tenemos que entenderlas.

¿Qué otras disciplinas habría que tener en cuenta?Al fin y al

cabo, la inteligencia artificial influirá en todo, por lo que habría que tener en cuenta todos los aspectos, desde las ciencias naturales hasta el arte. Pero la economía, la politología, la sociedad… Efectivamente, en la sociedad se necesita más debate.

¿Qué opina de las peticiones que se están planteando para detener la investigación durante un periodo de tiempo?Como

acabo de decir, me parece necesario debatir y reflexionar sobre el desarrollo y las consecuencias de la inteligencia artificial. Pero esas moratorias no van a ser nada realistas, no va a pasar. Es significativo que detrás de una de las solicitudes esté Elon Musk. Lo cierto es que hay una pugna entre compañías, y los que vienen detrás piden tiempo para que se puedan quedar con las anteriores.

Es mucho más importante entender cómo funcionan estos sistemas, qué consecuencias pueden tener y cómo podemos garantizar que se usen para el bien. Y eso hay que hacerlo con la gente, no se puede dejar todo en manos de las compañías.

¿Qué puede aportar el entendimiento artificial en el futuro, que ahora es impensable?

Esta pregunta no puede ser contestada. No se puede predecir lo que va a pasar. Incluso cuando se creó Internet, era imposible saber cómo lo usaríamos hoy en día y qué nos traería. Hoy en día contamos con sistemas capaces de crear poemas. Ahí hay un salto y en el futuro la conversación entre máquinas y personas será cada vez más común.

Tenemos que pensar cómo fortalecer a la sociedad para que sea consciente del buen y mal uso de la inteligencia artificial.

Buletina

Bidali zure helbide elektronikoa eta jaso asteroko buletina zure sarrera-ontzian