“És imprescindible debatre i reflexionar sobre la intel·ligència artificial”

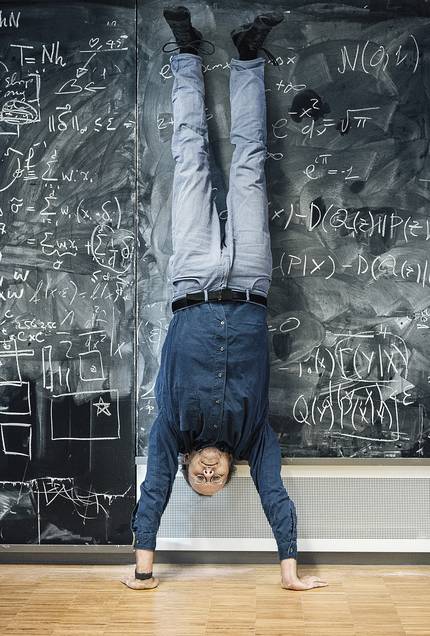

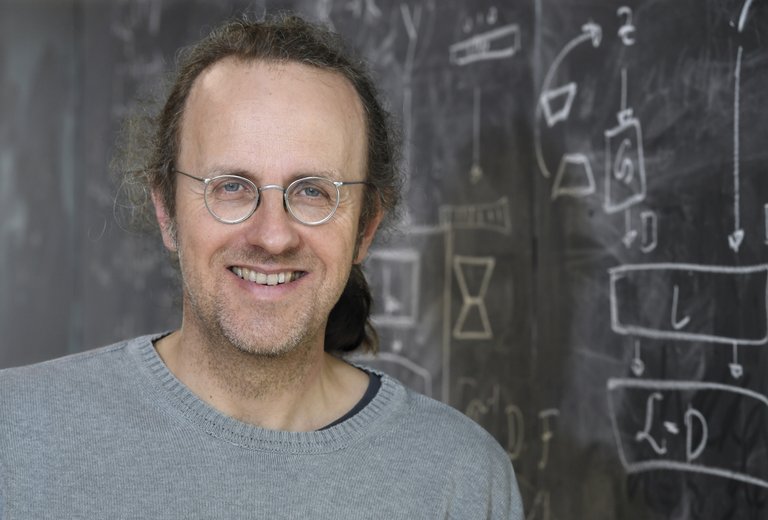

Bernhard Schölkopf és conegut en el món de la recerca sobre la intel·ligència artificial. Entre altres, és co-director de l'Institut de Sistemes Intel·ligents Max Planck (en concret, lidera el Departament d'Inferències Experimentals) i treballa en altres centres i institucions. Les seves recerques han rebut un gran ressò i reconeixement, entre ells, un dels premis BBVA 2020 “Fronteres del Coneixement” pel desenvolupament de mètodes kernel. El diàleg comença amb una pregunta sobre ells, però a continuació s'aborden altres temes: exoplanetes, accessibilitat, sostenibilitat, recerca militar, filosofia, transparència de la ciència i participació social…

És especialista en aprenentatge automàtic, especialment en mètodes de kernel o causalitat. Què has treballat en aquest camp?

Els mètodes Kernel són un camp d'aprenentatge automàtic. En realitat, són mètodes d'aprenentatge de normes, dependències o relacions a partir de les observacions, i són especials, ja que estan connectats a diferents camps de les matemàtiques: anàlisi funcional, teoria de l'optimització… Així, proporcionen una forma bonica i elegant d'aprendre regles a partir de dades, i poden ser utilitzats en camps tan diversos com la medicina o la indústria. Són útils no sols per a conèixer les relacions existents entre les dades, sinó per a anar més enllà i detectar la causalitat. Per tant, l'aprenentatge va un nivell més profund que l'automàtic.

Una de les aplicacions tal vegada no és la primera que se'ns ocorri. En concret, ho ha utilitzat en la detecció d'exoplanetes. Com va ser?

Bé. Estava passant un any sabàtic amb la meva família a Nova York i vaig començar a parlar amb astrònoms. A partir de les dades recollides pel telescopi espacial Kepler, em van dir que tenien un problema per a detectar exoplanetes. De fet, per a detectar exoplanetes, en passar per davant de la seva estrella, es basaven en la pèrdua de lluminositat de l'estrella. Però aquesta pèrdua és molt petita i és difícil distingir-la del soroll que produeix la pròpia observació. Aquest soroll i les fallades del telescopi es poden deduir de les dades d'altres estrelles, i l'aprofitem.

Amb això, en pocs anys es va trobar el carnet 20-30 exoplapis que posteriorment es va confirmar per altres mètodes. I, poc després, es va confirmar, a més, que una d'elles es trobava a una distància vivent de la seva estrella. Això significa que es trobava a una distància que permetés l'accés a l'aigua líquida. El primer exoplaneta que es va detectar va ser habitable.

En quins altres àmbits es pot aplicar?Per

defecte, en totes les àrees en les quals es poden realitzar observacions experimentals. És necessari, d'una banda, que existeixin moltes dades, molts mesuraments i, per un altre, que hi hagi relacions entre les diferents observacions. Per exemple, podem relacionar les mesures d'un biomarcador amb el risc de tenir un tumor, i podem saber si aquest bi-mar pot predir un tumor abans de detectar-lo. És a dir, una regla que es dedueix de les dades, fins i tot quan és difícil per a una persona, detectar-la.

A part dels mètodes de Kernel, quins creus que seran els principals desenvolupaments de la intel·ligència artificial?

Ara mateix un dels camps més excitants és el processament del llenguatge natural (NLP). Fa 20 o 10 anys, es van realitzar molts estudis sobre la visió computacional: com conèixer objectes, o com distingir cotxes i vianants… per exemple, per a desenvolupar cotxes automàtics. En els últims 10 anys s'han produït grans avanços en l'anàlisi del llenguatge i en la predicció de textos. De sobte, els programes són capaços de produir textos. Això ha creat sorpresa i fascinació, i crec que en els pròxims anys tindrà un gran desenvolupament.

Com podem garantir que els beneficis dels sistemes d'intel·ligència artificial arribin a tots?El primer

pas perquè els beneficis dels sistemes d'intel·ligència artificial siguin el més assequibles possible és la publicació de la recerca. No sols descriure mètodes en una revista científica, sinó també publicar el codi. És més, també les dades que s'han utilitzat per a entrenar aquest codi.

No obstant això, no és una qüestió de pa sucat amb oli. Per exemple, en medicina, les dades no es poden fer públics de qualsevol manera. O, en un altre aspecte, potser no és convenient, ja que existeix el risc que s'usin de manera malintencionada. Però, en general, si volem que sigui beneficiós per al major nombre de persones i de societats, crec que la recerca ha de ser el més transparent possible.

La intel·ligència artificial també pot generar problemes en altres àmbits, com el medi ambientÉs

cert que per a entrenar programes d'intel·ligència artificial fa falta molta energia, i aquesta energia consumeix molts recursos. I els centres de recerca no sempre estan en el lloc més adequat des del punt de vista de la sostenibilitat.

Però, des d'un altre punt de vista, la intel·ligència artificial també pot tenir un efecte beneficiós sobre el medi ambient. Efectivament, el clima és un sistema complex per al qual no tenim un model complet. Les intel·ligències artificials ens poden ajudar a comprendre millor el clima i ens ajudaran a frenar o mitigar el canvi climàtic. També ens ajudarà a crear millors tecnologies: millors cèl·lules solars, millors bateries el-tricas…

He llegit que vostè s'ha negat a participar en les recerques. És així?

Sí. Tradicionalment, en les guerres està implicat l'ésser humà. Algú decideix atacar o disparar a l'altre; algú mana i és una decisió d'algú. Això significa que hi ha responsabilitats i sentències morals.

I la guerra és sempre dolenta. Però si les màquines es tornen cada vegada més intel·ligents i se'ls assigna la responsabilitat de prendre aquestes decisions, de qui és la responsabilitat? De qui ha desenvolupat un programa per a conèixer i matar a una persona? De qui ho ha dissenyat? El que l'ha venut? Del govern que utilitza el sistema? És difícil preveure com això pot canviar la guerra.

Crec que cal discutir sobre això i que és una qüestió que cal analitzar amb molta cura. Però soc molt escèptic, no veig que estiguem fent això. Per tant, sempre intento protegir i encoratjar als qui diuen que cal prohibir aquest tipus d'armes.

D'altra banda, has estudiat filosofia. Creu que és utilitzable o, més encara, que és necessari tenir en compte la filosofia en el desenvolupament de la intel·ligència artificial?

Sens dubte, la filosofia m'ha estat molt útil. Crec que qualsevol cosa que aprenguis pot ser útil alguna vegada. I si has estudiat filosofia, influirà com penses en els problemes de la intel·ligència artificial. Per descomptat, molts tècnics s'ocupen únicament dels aspectes tècnics de la intel·ligència artificial. Però les preguntes que volem aclarir no són només tècniques, és a dir, com detectarem l'estructura del món? Per què sembla que el món està subjecte a les lleis i no a l'atzar? Al meu entendre, aquest tipus de preguntes són, en el fons, filosòfiques i des d'aquest punt de vista hem d'entendre-les.

Quines altres disciplines caldria tenir en compte?Al cap i a la fi

, la intel·ligència artificial influirà en tot, per la qual cosa caldria tenir en compte tots els aspectes, des de les ciències naturals fins a l'art. Però l'economia, la politologia, la societat… Efectivament, en la societat es necessita més debat.

Què opina de les peticions que s'estan plantejant per a detenir la recerca durant un període de temps?Com

acabo de dir, em sembla necessari debatre i reflexionar sobre el desenvolupament i les conseqüències de la intel·ligència artificial. Però aquestes moratòries no seran gens realistes, no passarà. És significatiu que darrere d'una de les sol·licituds estigui Elon Musk. La veritat és que hi ha una pugna entre companyies, i els que venen darrere demanen temps perquè es puguin quedar amb les anteriors.

És molt més important entendre com funcionen aquests sistemes, quines conseqüències poden tenir i com podem garantir que s'usin per al bé. I això cal fer-ho amb la gent, no es pot deixar tot en mans de les companyies.

Què pot aportar l'enteniment artificial en el futur, que ara és impensable?

Aquesta pregunta no pot ser contestada. No es pot predir el que passarà. Fins i tot quan es va crear Internet, era impossible saber com ho usaríem avui dia i què ens portaria. Avui dia comptem amb sistemes capaços de crear poemes. Aquí hi ha un salt i en el futur la conversa entre màquines i persones serà cada vegada més comuna.

Hem de pensar com enfortir a la societat perquè sigui conscient del bon i mal ús de la intel·ligència artificial.

Buletina

Bidali zure helbide elektronikoa eta jaso asteroko buletina zure sarrera-ontzian