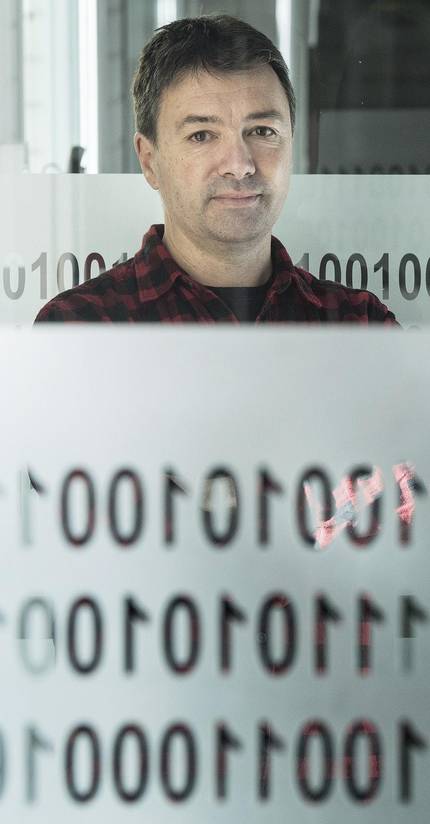

“Si as máquinas son capaces de entender ás persoas, avanzamos moito. As máquinas veñen ao noso mundo”

Sobre todo, o recoñecemento do traballo realizado. É una sinal de que a nosa investigación espertou interese e anímanos a seguir investigando. E o premio tamén dá un pouco de diñeiro paira contratar a unha persoa.

Cando utilizamos tradutores automáticos, moitas veces dámosnos/dámonos conta do mal que entenderon. Por exemplo, á hora de volver “Trens mañá e tarde”, en lugar de “Trens mañá e tarde”, pode facer Trens mañá e tarde”. Por que? Moitas veces é porque non entendeu de que falamos. Hai palabras que poden ter máis dun significado e a máquina non sabe cal elixir neste caso.

De feito, a miña liña de investigación é esa, o procesamiento da linguaxe, e dentro dela ten que ver coa semántica ou significado, a semántica computacional. Paira iso, representamos os significados das palabras nun espazo, como nun mapa. Pomos palabras de diferentes linguas, no noso caso inglés, eúscaro e castelán, e nese mapa temos marcados os puntos que corresponden aos seus significados. Por exemplo, temos una palabra: “banco”, que significa “caixa de aforros” nun punto do mapa, pero tamén temos o significado de “cadeira” noutro punto. Igual a palabra “mañá” que pode ser “mañá” ou “mañá”. Se nós facemos ben este mapa, logo, cando a máquina empeza a comprender un texto, poderá situar se ese “banco” é paira sentarse ou paira sacar diñeiro.

Analiza as distancias entre puntos. Si é capaz de colocar calquera frase no mapa, pode actuar con distancias paira coñecer o significado da palabra neste caso. O contexto da palabra aclararao: saberá en función das outras palabras da frase que palabra está preto do seu mapa, da palabra “caixa” ou “cadeira”. Por exemplo, se preguntamos á máquina: “Cal é o banco máis solvente?”. “Solvencia” significa “caixa de aforros”.

Esperamos que este ano se produzan avances importantes á hora de plasmar os conceptos no mapa. E avanzamos, pero aínda non conseguimos demostrar que eses mapas que conseguimos son mellores que as palabras. Pero tivemos melloras noutra cousa: agora somos capaces de tomar mapas independentes paira dúas linguas e de unificar ambos os mapas nun. É dicir, podemos facer un bo mapa paira o eúscaro, outro paira o castelán e outro paira o inglés, e logo pór o tres no mesmo espazo. Niso tivemos bos resultados, agora facemos mellores mapas.

Pois nese mapa queremos pór frases, non só palabras. Aí está o reto. É dicir, paira traducir correctamente una frase, a máquina debe comprender ben a frase. Iso é o que facemos os seres humanos, en definitiva. Nós non traducimos literalmente. Primeiro temos que entender a que se refire, o contexto e logo comprendemos o núcleo da frase. Á máquina ocórrelle o contrario: é capaz de entender os fragmentos literalmente, pero logo cústalle moito xuntalos. Entón, un reto actual é pór no mapa o significado de frases completas. Ao recibir calquera frase, o sistema sabería onde está no mapa e entenderíao en función diso.

Se ademais dos significados literais queres introducir os segundos sentidos no mapa, é posible. A propia máquina aprende moitas veces significados de segundo sentido. É sorprendente, pero neste mapa, ademais do seu significado intrínseco, traballa as connotacións. Por exemplo, despois de estudar moitos textos, o médico aprende que na maioría dos casos son homes. Ou en Estados Unidos aprende que a miúdo os ladróns son negros. Tamén estuda tópicos.

Hai un gran reto intelectual: se as máquinas son capaces de entender ás persoas, avanzamos moito. As máquinas veñen ao noso mundo, non? A súa comprensión é moi atractiva. O obxectivo é que todas as máquinas teñan máis intelixencia cando interactúen connosco para que saiban que cando che espertas queres que se ilumine ou que se acenda a radio…

Pór o coñecemento que temos os seres humanos na forma de entender as máquinas é un gran reto. Por suposto, hai una razón práctica: o mundo da tradución automática move millóns e millóns de euros cada ano en Europa.

A verdade é que hai un dos principais retos. Moitas veces isto percíbese polo interese da industria e hoxe en día todos os xigantes do software, Microsoft, Google, Facebook, IBM, están a traballar intensamente no procesamiento da linguaxe. Eu creo que un gran paso adiante virá de aquí.

Outro gran reto é comprender as imaxes. Por exemplo, se sacases una foto como estamos nós, que a máquina comprenda que hai dúas persoas, que hai una mesa, que hai un reloxo detrás de ti… Xa entenden algunhas cousas. Algunhas escenas adáptanse bastante ben. Pero noutras escenas están completamente perdidas.

Pode ser útil, por exemplo, na domótica. Se tes un sistema paira axudarche en casa, ten dúas maneiras de saber o que está a pasar en casa: una é a voz e a outra é a cámara. Se hai una cámara mirando a ti e sabe o que está a pasar, saberá tamén o que ten que facer: apagar a luz, acender a luz, apagar o espertador se che levantaches antes… Vendo o que estás a facer, pode saber que facer.

Isto xa dota á máquina de máis capacidade. Non se trata de falar só, senón de entender o que ve. Cada vez estamos máis cerca. As persoas entendémonos porque como estamos a ver o mesmo falamos diso. Tamén é un recurso importante paira as máquinas.

Hai usos máis preocupantes: agora hai moitas cámaras na rúa paira previr. Comproban se alguén está a facer algo raro. Sen necesidade de mirar, a máquina acendería a alarma automaticamente.

Antigamente dicíase que una lingua quedaría atrás se non tiña un dicionario e una gramática detrás. A situación actual é similar: agora necesitamos estes dicionarios e esas gramáticas paira as máquinas.

Actualmente temos o eúscaro como opción paira os móbiles. Pero si Google incluíu o eúscaro dentro de Android e os seus sistemas é porque hai recursos paira o eúscaro. Estes dicionarios son necesarios paira poder realizar unha análise sintáctico ou morfológico. Se una lingua non ten recursos, se non ten dicionarios e gramáticas electrónicas, corre o risco de quedar atrás. As grandes compañías non van asumir a creación destes recursos.

No noso grupo de investigación, o grupo IXA, levamos 25 anos traballando e desde o principio parte da motivación era avanzar no proceso lingüístico para que o eúscaro tivese recursos paira non quedar á marxe e avanzar xunto ás grandes linguas.

Neste momento, no caso do eúscaro, a situación é bastante boa. Hai listas de idiomas que especifican os recursos de cada un deles, e o eúscaro está entre os primeiros.

Buletina

Bidali zure helbide elektronikoa eta jaso asteroko buletina zure sarrera-ontzian