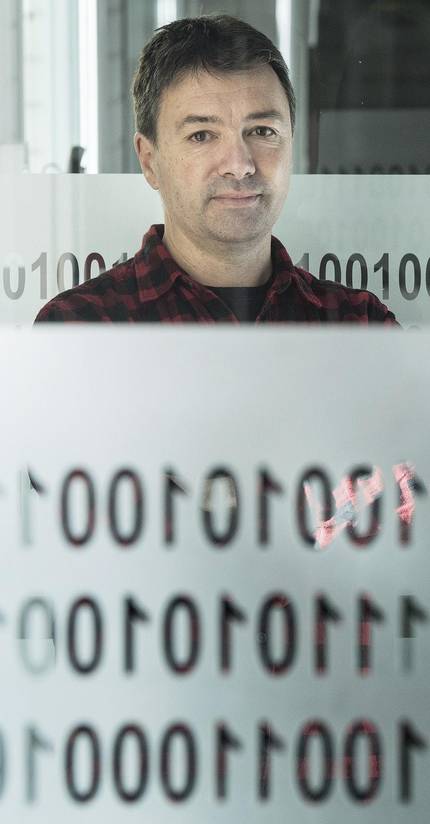

“Si las máquinas son capaces de entender a las personas, hemos avanzado mucho. Las máquinas vienen a nuestro mundo”

Sobre todo, el reconocimiento del trabajo realizado. Es una señal de que nuestra investigación ha despertado interés y nos anima a seguir investigando. Y el premio también da un poco de dinero para contratar a una persona.

Cuando utilizamos traductores automáticos, muchas veces nos damos cuenta de lo mal que han entendido. Por ejemplo, a la hora de volver “Trenes mañana y tarde”, en lugar de “Trenes mañana y tarde”, puede hacer “Trenes mañana y tarde”. ¿Por qué? Muchas veces es porque no ha entendido de qué hablamos. Hay palabras que pueden tener más de un significado y la máquina no sabe cuál elegir en este caso.

De hecho, mi línea de investigación es esa, el procesamiento del lenguaje, y dentro de ella tiene que ver con la semántica o significado, la semántica computacional. Para ello, representamos los significados de las palabras en un espacio, como en un mapa. Ponemos palabras de diferentes lenguas, en nuestro caso inglés, euskera y castellano, y en ese mapa tenemos marcados los puntos que corresponden a sus significados. Por ejemplo, tenemos una palabra: “banco”, que significa “caja de ahorros” en un punto del mapa, pero también tenemos el significado de “silla” en otro punto. Igual la palabra “mañana” que puede ser “mañana” o “mañana”. Si nosotros hacemos bien este mapa, luego, cuando la máquina empieza a comprender un texto, podrá ubicar si ese “banco” es para sentarse o para sacar dinero.

Analiza las distancias entre puntos. Si es capaz de colocar cualquier frase en el mapa, puede actuar con distancias para conocer el significado de la palabra en este caso. El contexto de la palabra lo aclarará: sabrá en función de las otras palabras de la frase qué palabra está cerca de su mapa, de la palabra “caja” o “silla”. Por ejemplo, si preguntamos a la máquina: “¿Cuál es el banco más solvente?”. “Solvencia” significa “caja de ahorros”.

Esperamos que este año se produzcan avances importantes a la hora de plasmar los conceptos en el mapa. Y hemos avanzado, pero todavía no hemos conseguido demostrar que esos mapas que conseguimos son mejores que las palabras. Pero hemos tenido mejoras en otra cosa: ahora somos capaces de tomar mapas independientes para dos lenguas y de unificar ambos mapas en uno. Es decir, podemos hacer un buen mapa para el euskera, otro para el castellano y otro para el inglés, y luego poner los tres en el mismo espacio. En eso hemos tenido buenos resultados, ahora hacemos mejores mapas.

Pues en ese mapa queremos poner frases, no sólo palabras. Ahí está el reto. Es decir, para traducir correctamente una frase, la máquina debe comprender bien la frase. Eso es lo que hacemos los seres humanos, en definitiva. Nosotros no traducimos literalmente. Primero tenemos que entender a qué se refiere, el contexto y luego comprendemos el núcleo de la frase. A la máquina le ocurre lo contrario: es capaz de entender los fragmentos literalmente, pero luego le cuesta mucho juntarlos. Entonces, un reto actual es poner en el mapa el significado de frases completas. Al recibir cualquier frase, el sistema sabría dónde está en el mapa y lo entendería en función de ello.

Si además de los significados literales quieres introducir los segundos sentidos en el mapa, es posible. La propia máquina aprende muchas veces significados de segundo sentido. Es sorprendente, pero en este mapa, además de su significado intrínseco, trabaja las connotaciones. Por ejemplo, después de haber estudiado muchos textos, el médico aprende que en la mayoría de los casos son hombres. O en Estados Unidos aprende que a menudo los ladrones son negros. También estudia tópicos.

Hay un gran reto intelectual: si las máquinas son capaces de entender a las personas, hemos avanzado mucho. Las máquinas vienen a nuestro mundo, ¿no? Su comprensión es muy atractiva. El objetivo es que todas las máquinas tengan más inteligencia cuando interactúen con nosotros para que sepan que cuando te despiertas quieres que se ilumine o que se encienda la radio…

Poner el conocimiento que tenemos los seres humanos en la forma de entender las máquinas es un gran reto. Por supuesto, hay una razón práctica: el mundo de la traducción automática mueve millones y millones de euros cada año en Europa.

La verdad es que hay uno de los principales retos. Muchas veces esto se percibe por el interés de la industria y hoy en día todos los gigantes del software, Microsoft, Google, Facebook, IBM, están trabajando intensamente en el procesamiento del lenguaje. Yo creo que un gran paso adelante vendrá de aquí.

Otro gran reto es comprender las imágenes. Por ejemplo, si sacaras una foto como estamos nosotros, que la máquina comprenda que hay dos personas, que hay una mesa, que hay un reloj detrás de ti… Ya entienden algunas cosas. Algunas escenas se adaptan bastante bien. Pero en otras escenas están completamente perdidas.

Puede ser útil, por ejemplo, en la domótica. Si tienes un sistema para ayudarte en casa, tiene dos maneras de saber lo que está pasando en casa: una es la voz y la otra es la cámara. Si hay una cámara mirando a ti y sabe lo que está pasando, sabrá también lo que tiene que hacer: apagar la luz, encender la luz, apagar el despertador si te has levantado antes… Viendo lo que estás haciendo, puede saber qué hacer.

Esto ya dota a la máquina de más capacidad. No se trata de hablar solo, sino de entender lo que ve. Cada vez estamos más cerca. Las personas nos entendemos porque como estamos viendo lo mismo hablamos de ello. También es un recurso importante para las máquinas.

Hay usos más preocupantes: ahora hay muchas cámaras en la calle para prevenir. Comprueban si alguien está haciendo algo raro. Sin necesidad de mirar, la máquina encendería la alarma automáticamente.

Antiguamente se decía que una lengua quedaría atrás si no tenía un diccionario y una gramática detrás. La situación actual es similar: ahora necesitamos estos diccionarios y esas gramáticas para las máquinas.

Actualmente tenemos el euskera como opción para los móviles. Pero si Google ha incluido el euskera dentro de Android y sus sistemas es porque hay recursos para el euskera. Estos diccionarios son necesarios para poder realizar un análisis sintáctico o morfológico. Si una lengua no tiene recursos, si no tiene diccionarios y gramáticas electrónicas, corre el riesgo de quedarse atrás. Las grandes compañías no van a asumir la creación de estos recursos.

En nuestro grupo de investigación, el grupo IXA, llevamos 25 años trabajando y desde el principio parte de la motivación era avanzar en el proceso lingüístico para que el euskera tuviera recursos para no quedarse al margen y avanzar junto a las grandes lenguas.

En este momento, en el caso del euskera, la situación es bastante buena. Hay listas de idiomas que especifican los recursos de cada uno de ellos, y el euskera está entre los primeros.

Buletina

Bidali zure helbide elektronikoa eta jaso asteroko buletina zure sarrera-ontzian