Para que la máquina hable de la propia voz

Inma Hernaez Rioja es profesora catedrática de la Escuela Superior de Ingeniería de Bilbao y fundadora del grupo de investigación Aholkularitza. El grupo nació en 1995 dentro de la UPV/EHU y trabaja el habla automática en euskera. Ha sido un trabajo bastante silencioso hasta ahora. De hecho, el eco y la acogida que ha tenido el último proyecto, | MyTTS, ha sido tan grande que tuvieron que suspender temporalmente el sistema.

Detrás de este éxito se encuentra el trabajo de muchos años y en el punto de partida una vivencia personal: La hermana de Hernaez perdió la voz por una operación. Y su trayectoria ha sido impulsada por ayudarle a comunicarse con él y con otros. “Mi hermana ha sido el primer usuario de nuestros desarrollos. En una ocasión homenajearon a un amigo íntimo de su hermana, quien dio una pequeña charla gracias a la aplicación. Darme esa oportunidad me ha dado mucha fuerza para avanzar en la investigación”.

Desde sus inicios hasta la actualidad, el desarrollo ha sido notable. Hace 20 años, para conseguir una buena calidad en las técnicas de síntesis de voz, se necesitaban muchas horas de grabación de una persona. Por ejemplo, para conseguir la voz que tiene Siri, Hernaez ha dicho que tardarían unas 30 horas. Además, debía grabarse en un estudio con una calidad muy buena.

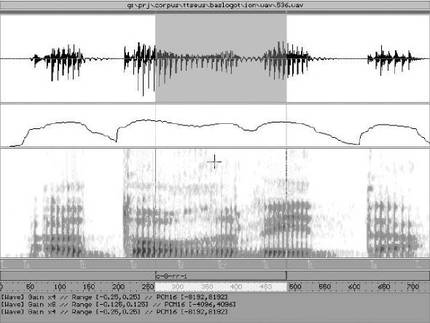

La técnica se basaba en el procedimiento “cortar y pegar”. No se cortaban palabras o frases, sino pequeñas unidades: difonemas, trifonemas, vocales o consonantes con el contexto... Posteriormente, dependiendo del contexto, el algoritmo determinaba qué unidad escoger de la base de datos. “Se llamaba síntesis basada en corpus. Era muy caro”, ha precisado.

Utilidad y calidad

El siguiente paso se remonta al año 2002 gracias a la síntesis estadístico-paramétrica. Esta técnica consiste, en primer lugar, en la parametrización de las señales de voz y, posteriormente, en la interconexión de estos parámetros mediante un tratamiento estadístico. Explica que la calidad no es tan buena como la del sistema anterior, pero con mucho menos grabación se consigue un resultado aceptable. Además, su carácter estadístico le confiere una gran flexibilidad al poder adaptar el modelo estadístico a cualquier muestra.

Así explica el proceso. “Tenemos voz media. Esa voz no es de nadie, está hecha con muchas voces y ponentes. No son cualquier ponente, suelen ser ponentes profesionales, la voz media se obtiene a partir de su grabación. Después, esta voz se puede adaptar a la voz de cualquier usuario, para lo que basta con tener una muestra de cien frases”.

En estas cien frases hay todas las combinaciones sonoras y la grabación dura media hora. El avance es evidente, ya que facilita enormemente que cualquier persona tenga una voz sintética adaptada a su voz. “De hecho, si grabamos más frases se consigue una mejor calidad, pero no podemos pedir más esfuerzo que eso”, dice Hernaez.

Tiene otras limitaciones. Por ejemplo, no es capaz de expresar emociones: “Grabando un corpus con emociones se puede conseguir, pero en este proyecto las frases son neutras y no hacemos el análisis del texto para buscar emociones. Sin embargo, se puede poner en el texto, pero no lo hacemos”.

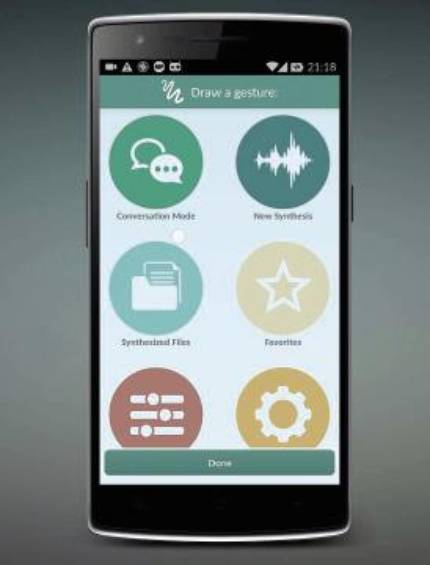

Pero las ventajas son evidentes: el sintetizador no coge memoria, lo han implementado fácilmente en Android, funciona en tiempo real en el móvil... Todo ello permite a cualquier persona utilizarlo en su día a día. Y ese era el objetivo inicial.

De hecho, Hernaez ha reconocido que existen en la actualidad sistemas que ofrecen una mayor calidad, especialmente basados en redes neuronales: “La tecnología actual de síntesis es muy buena. Yo te enseñaría algunas frases y tú no serías capaz de distinguir si es sintético o natural. Pero no podríamos entrar en Android o utilizarlo en tiempo real”.

Del laboratorio al usuario

Y esa es la sangría: en el día a día las personas que necesitan voz sintética para comunicarse tienen que utilizar los sistemas que hay y son muy limitados. Así, en muchos casos, las mujeres deben utilizar la voz humana; o los hablantes de lenguas minorizadas, el lenguaje hegemónico; o los niños, el de Siri. El objetivo de Hobe ha sido reducir la distancia entre la voz del usuario y la que ofrece el sintetizador.

Se ha procurado que el sistema desarrollado sea lo más cómodo y sencillo posible para el usuario. El funcionamiento es el siguiente: “El usuario graba primero esas cien frases, en euskera o en castellano, y se crea automáticamente una aplicación con su voz sintética. A continuación lo recibirá por correo electrónico y sólo tendrá que hacer click para bajarlo a su móvil Android. La voz se graba como voz del sistema, por lo que puede utilizarla no sólo en nuestra aplicación de comunicación, sino también en otras aplicaciones como leer libros en muchos e-reader o en Adobe. Y se pueden comunicar en tiempo real”.

Por su parte, las personas con movilidad muy limitada utilizan tablet y palanca o lector de iris. En este caso lo integran en Windows.

Entre los usuarios se encuentran las personas con esclerosis lateral amiotrófica. En principio, el proyecto pretende ayudar a cualquier persona que haya perdido su voz, pero cuando la pérdida es repentina (por ejemplo, debido a un ictus), es difícil conseguir su voz sintética. Por su parte, las personas con esclerosis lateral amiotrófica pierden progresivamente su capacidad de movimiento. Por tanto, desde que reciben el diagnóstico tienen tiempo para realizar la grabación y crear su propia voz sintética.

En los últimos tres o cuatro años, junto con Biocruces, han trabajado con pacientes a los que había que hacer laringectomía. ”Los laringectomizados pueden hablar con la voz esofágica, pero con esta colaboración los médicos informaban a los pacientes para realizar la grabación antes de la intervención. Así que después tenían la aplicación, porque en las primeras semanas no pueden hablar”, explica Hernaez. Dice que esta colaboración ha dado un gran impulso al proyecto.

Ahora siguen trabajando para mejorar la calidad (tienen un nuevo algoritmo) y para acortar el camino que se hace desde el laboratorio al usuario. También se está haciendo un esfuerzo para que la voz del niño esté disponible, incluso en otras lenguas, como el catalán. Objetivo final: que todas las personas que lo necesiten tengan la posibilidad de comunicarse a través de la voz sintética de la manera más personalizada, natural y sencilla posible.

Buletina

Bidali zure helbide elektronikoa eta jaso asteroko buletina zure sarrera-ontzian